图像匹配

应用:

目标识别、目标跟踪、超分辨率影像重建、视觉导航、图像拼接、三维重建、视觉定位、场景深度计算。

方法:

基于深度学习的特征点匹配算法、实时匹配算法、3维点云匹配算法、共面线点不变量匹配算法,以及基于深度学习的图像区域匹配等。

分类:

局部不变特征点匹配、直线匹配、区域匹配。

Part1:局部不变特征点匹配-2D

1. 什么是图像特征点?- 关键点+描述子

关键点:指特征点在图像中的位置,具有方向、尺度等信息;

描述子:描述子通常是一个向量,描述关键点邻域的像素信息。

2. 如何进行特征点匹配?- 人工设计检测器

在向量空间对两个描述子进行比较,距离相近则判定为同一个特征点。

角点、边缘点等都可以作为潜在特征点:

SIFT总结【5】:许允喜等,对局部图像描述符进行分析描述,对这类方法的计算复杂度、评价方法和应用领域予以总结。

SIFT总结【4】:刘立等,对 SIFT 算法的演变以及在不同领域的典型应用进行了较为全面的论述,并比较了各类算法的优缺点。

SIFT算法改进【9】【10】【11】:针对算法时间复杂度高,PCA-SIFT, SURF, SSIF。

SIFT算法改进【12】:对彩色图 像进行处理的 CSIFT( colored SIFT)。

SIFT算法改进【13】:使用对数极坐标分级结构的 GLOH( gradient location and orientation histogram)。

SIFT算法改进【14】:具有仿射不变性的ASFIT( affine SIFT)。

Fast【2】:通过邻域像素对比进行特征点检测并引入机器学习加速这一过程,可应用在对实时性要求较高的场合,如视频监控中的目标识别。由于 FAST 仅处理单一尺度图像,且检测的不仅仅是“角点”这一特征,还可以检测到其他符合要求的特征点,如孤立的噪点等。当图像中噪点较多时会产生较多外点,导致鲁棒性下降。

Harris【1】:通过两个正交方向上强度的变化率对角点进行定义,其本身存在尺度固定、像素定位精度低、伪角点较多和计算量大等问题。

Harris改进算法【6】:将多分辨率思想引入 Harris 角点,解决了Harris算法不具有尺度变化的问题。

Harris改进算法【7】:在 Harris 算法中两次筛选候选点集,利用最小二乘加权距离法实现角点亚像素定位,大幅度提高角点检测效率和精度。

Harris改进算法【8】:将灰度差分及模板与 Harris 算法相结合,解决了 Harris 算法中存在较多伪角点和计算量大等问题。

角点检测算法 - 最常用:基于图像灰度的方法。

邻域像素检测。

SIFT【3】:不再局限于对角点检测。

3. 如何进行特征点匹配?

3.1 深度学习特征检测器 - 局部特征点的重复检测

FAST-ER算法【15】:把特征点检测器定义为一种检测高重复点的三元决策树,并采用模拟退火算法对决策树进行优化,从而提高检测重复率。由于在每次迭代过程中,都需要对重新应用的新决策树进行检测,且其性能受到初始关键点检测器的限制,降低了该算法的鲁棒性。

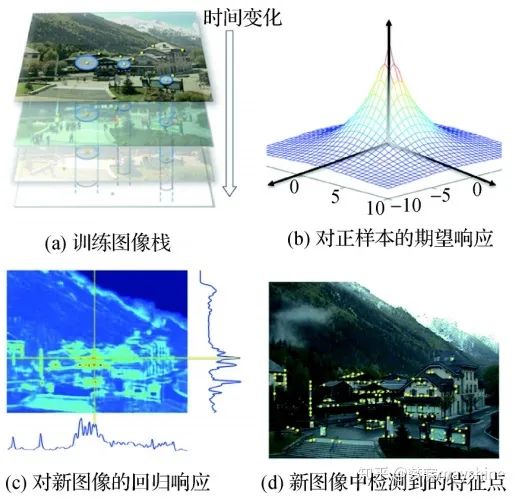

时间不变特征检测器( TILDE) 【16】:Verdie等人提出,能够较好地对由天气、季节、时间等因素引起的剧烈光照变化情况下的可重复关键点进行检测。参与训练的候选特征点是由多幅训练图像中采用 SIFT 算法提取的可重复关键点组成,如图a;正样本是以这些点为中心的区域,负样本是远离这些点的区域。在进行回归训练时,正样本 在特征点位置返回最大值,远离特征点位置返回较小值,如图 b ; 回归测试时,将测试图像分成固定大小的图像块,其回归响应如图c ,然后根据非极大值抑制提取特征点,如图d 。该方法适用于处理训练数据和测试数据为同一场景的图像。(TILDE 采用手动标记的数据作为区分性特征训练,使用DOG-difference of Gaussian收集训练集,对于跨模态任务如RGB/深度模态对不再适用)

基于学习的协变特征检测器【17】:综合考虑两个局部特征检测器特性(检测可区分的特征;协变约束-在不同的变换下重复检测一致特征),Zhang 等人提出。该方法将 TILDE 的输出作为候选标准图像块,通过变换预测器的训练建立学习框架,将局部特征检测器的协变约束转化为变换预测器的协变约束,以便利用回归( 如深度神经网络) 进行变换预测。预测的变换有两个重要性质: 1) 变换的逆矩阵能将观察到的图像 块映射到“标准块”,“标准块”定义了具有可区分性的图像块以及块内“典型特征”( 如单位圆) 的位置和形状; 2) 将变换应用到“典型特征”可以预测图像 块内变换特征的位置和形状。

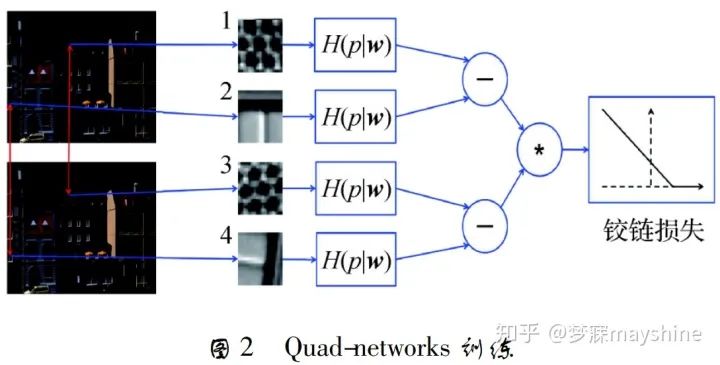

Quadnetworks【18】:采用无监督学习方式进行特征点检测。Savinov 等人提出,该方法将关键点检测问题转化为图像变换上的关键点一致性排序问题,优化后的排序在不同的变换下具有重复性,其中关键点来自响应函数的顶/底部分位 数。Quad-networks 的训练过程如图所示,在两幅图像中提取随机旋转像块对( 1,3) 和( 2,4) ; 每个块 经过神经网络输出一个实值响应 H( p w) ,其中 p 表示点,w 表示参数向量; 通过四元组的排序一致函数计算铰链损失,并通过梯度下降法优化。Quadnetworks 在 RGB/RGB模式和RGB/深度模式的重复检测性能均优于 DOG,可以和基于学习的描述符 相结合进行图像匹配,还可用于视频中的兴趣帧检测。

3.2 深度学习特征描述符学习

用于特征点描述符判别学习的 DeepDesc【19】:Simo-Serra 等人提出,该方法采用 Siamese 网络侧重训练难以区分类别的样本,输入图像块对,将 CNN 输出的非线性映射作为描述符,采用欧氏距离计算相似性并最小化其铰链损失。该方法适用于不同的数据集和应用,包括宽基线图像匹配、非刚性变形和极端光照变化的情况,但该方法需要大量的训练数据来保证其鲁棒性。

3.3 深度学习各阶段统一

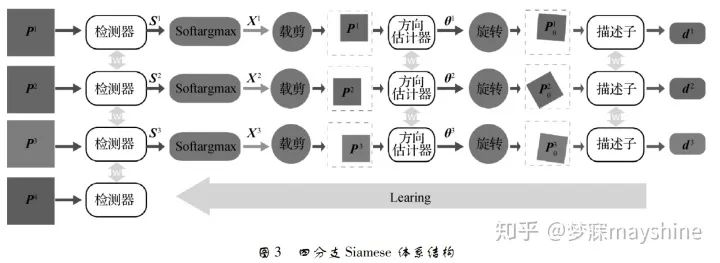

Yi 等人提出【20】:基于学习的不变特征变换( LIFT) 结合空间变换网络【21】和 Softargmax 函数,将基于深度学习的特征点检测【16】、基于深度学习的方向估计【22】和基于深度学习的描述符【19】连接成一个统一网络,从而实现完整特征点匹配处理流水线。其中图像块的裁剪和旋转通过空间变换网络实现,训练阶段采用四分支 Siamese 网络,输入特征点所在图像块,其位置和方向均来自 SFM 算法的输出,其中 P1 和 P2 为同一3D点在不同视角下的图像,P3 为不同3D点的投影的图像块,P4 为不包含任何特征点的图像快,S 为得分图,x 代表特征点位置。采用从后至前的训练策略,即先训练描述子,再训练方向估计,最后训练特征点检测。测试阶段,将特征点检测与方向估计及描述子分开,使优化问题易于处理。LIFT 方法的输入为多尺度图像,以滑窗形式进行特征点检测,提取局部块逐个分配方向,再计算描述子。与 SIFT 相比,LIFT 能够提取出更为稠密的特征点,且对光照和季节变化具有很高的鲁棒性。

3.4 不同对象或场景的匹配方法研究(图像语义匹配):

与考虑在时间(光流) 或空间(立体) 相邻的图像特征对应不同,语义对应的特征是图像具有相似的高层结构,而其精确的外观和几何形状可能不同。

3.4.1 相同对象类的像对匹配

经 典 SIFT 流方法【23】:提出不同场景的稠密对应概念,通过平滑约束和小位移先验计算不同场景间的稠密对应关系。

Bristow 等人【24】:将语义对应问题转化为约束检测问题,并提出Examplar-LDA( Examplar linear discriminant analysis) 分类器。首先对匹配图像中的每个像素学习一个 Examplar-LDA 分类器,然后以滑动窗口形式将其应用到目标图像,并将所有分类器上的匹配响应与附加的平滑先验结合,从而获得稠密的对应估计。该方法改善了语义流的性能,在背景杂乱的场景下具有较强鲁棒性。

3.4.2 不同对象类的像对匹配

Novotny 等人【25】:提出基于几何敏感特征的弱监督学习方法AnchorNet。在只有图像级标签的监督下,AnchorNet 依赖一组从残差超列 HC( hypercolumns) 中提取具有正交响应的多样过滤器,该过滤器在同一类别的不同实例或两个相似类别之间具有几何一致性。AnchorNet 通过在 ILSVRC12 ( imagenet large scale visual recognition competition 2012) 上预先训练的深度残差网络( ResNet50) 模型初始化网络参数,并采用两阶段优化与加速训练完成匹配。

3.4.3 多图像语义匹配

可以找到多个图像间的一致对应关系,从而在应用中发挥更为重要的作用:

对象类模型重建【26】

自动地标注释【27】

Wang 等人【28】:将多图像间的语义匹配问题转化为特征选择与标注问题,即从每幅图像的初始候选集中选择一组稀疏特征点,通过分配标签建立它们在图像间的对应关系。该方法可以为满足循环一致性和几何一致性的图像集合建立可靠的特征对应关系,其中循环一致性可以对图像集合中的可重复特征进行选择和匹配。低秩约束用于确保特征对应的几何一致性,并可同时对循环一致性和几何一致性进行优化。该方法具有高度可扩展性,可以对数千幅图像进行匹配,适用于在不使用任何注释的情况下重构对象类模型。

3.5 图像匹配应用于临床的精确诊疗

通过精确比对器官的几何形状,来判断脏器是否存在病变;通过分析肿瘤的几何特征,来判断肿瘤是否为恶性。

Yu 等人[29]提 出 A-NSIFT( accelerated multi-dimensional scale invariant feature transform) 与 PO-GMMREG( parallel optimization based on gaussian mixture model registration) 相结合的方法,改进了特征提取和匹配过程。ANSIFT 为加速版 NSIFT,采用 CUDA 编程加速 NSIFT 的前两个步骤,用于提取匹配图像和待匹配图像中的特征点( 仅保留位置信息) 。PO-GMMREG 是基于并行优化的高斯混合模型( GMM) 匹配算法,并行优化使得匹配图像和待匹配图像可以任意旋转角度对齐。该方法可以减少时间消耗,提高大姿态差异下的匹配精度。

TV-L1 ( total variation-L1 ) 光流模型[30]能有效地保持图像边缘等特征信息,但对于保持具有弱导数性质的纹理细节信息仍不够理想。

张桂梅等人[31]将 G-L ( Grünwald-Letnikov ) 分数阶微分理论引入TV-L1 光流模型,代替其中的一阶微分,提出分数阶 TV-L1 光流场模型 FTV-L1 ( fractional TV-L1 ) 。同时给出匹配精度和 G-L 分数阶模板参数之间关系,为最佳模板选取提供依据。FTV-L1 模型通过全变分能量方程的对偶形式进行极小化以获得位移场,可以解决图像灰度均匀,弱纹理区域匹配结果中的信息模糊问题。该方法能有效提高图像匹配精度,适合于包含较多弱纹理和弱边缘信息的医学图像匹配。

为了解决待匹配图像对中目标的大形变和灰度分布呈各向异性问题,陆雪松等人[32]将两幅图像的 联合 Renyi α -entropy 引入多维特征度量并结合全局和局部特征,从而实现非刚性匹配。首先,采用最小距离树构造联合Renyi α -entropy 度量准则;其次,根据该度量相对形变模型 FFD( free-form deformation) 的梯度解析表达式,采用随机梯度下降法进行优化; 最后,将图像的 Canny 特征和梯度方向特征融入度量中,实现全局和局部特征的结合。该方法的匹配精度与传统互信息法和互相关系数法相比有明显提高,且新度量方法能克服因图像局部灰度分布不一致造成的影响,能够在一定程度上减少误匹配。

Yang 等人[33] 提出的 FMLND( feature matching with learned nonlinear descriptors) 采用基于学习的局部非线性描述符 LND 进行特征匹配,对来自 T1w 和 T2w 两种不同成像参数的磁共振成像( MRI) 数据的 CT( computed tomography) 图像进行预测。该过程分为两个阶段: 学习非线性描述符和预测 pCT( pseudo CT) 图像。第 1 阶段,首先采用稠密 SIFT 提取 MR 图像的特征; 其次通过显式特征映射将其投影到高维空间并与原始块强度结合,作为初始非线性描述符; 最后在基于改进的描述符学习( SDL) 框架中学习包含监督的 CT 信息的局部描述符。第 2 阶段,在训练 MR 图像的约束空间内搜索输入 MR 图像的局部描述符的 K 最近邻域,和对应原始 CT 块进行映射,对重叠的 CT 块进行加权平均处理得到最终的pCT 块。与仅使用成像参数 T1w 或 T2w 的 MR 图像方法相比,FMLND 方法提高了预测的准确率。

对骨盆CT和MRI匹配可以促进前列腺癌放射治疗两种方式的有效融合。由于骨盆器官的模态外观间隙较大,形状/外观变化程度高,导致匹配困难。基于此,Cao 等人【34】提出基于双向图像合成的区域自适应变形匹配方法,用于多模态骨盆图像的匹配,双向图像合成,即从MRI合成CT并从CT合 成MRI。多目标回归森林 MT-RF 采用CT模式和MRI模式对方向图像合成进行联合监督学习,消除模态之间的外观差异,同时保留丰富的解剖细节,其匹配流程为: 首先,通过 MT-RF 合成双向图像,获得实际CT和合成CT( S-CT) 的CT像对以及实际MRI和合成 MRI( S-MRI) 的 MRI 像对;其次,对CT像对的骨骼区域和 MRI像对的软组织区域进行检测,以结合两种模式中的解剖细节;最后,利用从两种模式中选择的特征点进行对称匹配。在匹配过程中,特征点数量逐渐增加,对形变场的对称估计起到较好的分级指导作用。该方法能够较好地解决骨盆图像匹配问题,具有较高的准确性和鲁棒性。

3.6 图像匹配应用于遥感图像处理-高分辨率

何梦梦等人【35】对细节纹理信息丰富的高分辨率光学及 SAR( synthetic aperture radar) 遥感图像进行分析,提出一种特征级高分辨率遥感图像快速自动匹配方法。该方法首先对匹配图像和待匹配图像进行 Harr 小波变换,将其变换到低频近似图像再进行后续处理,以提高图像匹配速度;接着对光学图像和 SAR 图像分别采用 Canny 算子和 ROA( ratio of averages) 算子进行边缘特征提取,并将边缘线特征转换成点特征;而后通过匹配图像和待匹配图像中每对特征点之间的最小和次小角度之比确定初始匹配点对,并通过对随机抽样一致性算法( RANSAC) 添加约束条件来滤除错误匹配点对;最后采用分块均匀提取匹配点对的方法,进一步提高匹配精度。该方法能快速实现并具有较高的配准精度和较好的鲁棒性。

3.7 剔除误差匹配

3.7.1 几何约束为参数的情况,如要求相应点位于极线上

Fischler 等 人[36]提出 RANSAC 方法,采用迭代方式从包含离群数据的数据集中估算出数学模型。进行匹配点对的提纯步骤为: 1) 从已匹配的特征点对数据集中随机抽取四对不共线的点,计算单应性矩阵 H,记作模型 M; 2) 设定一个阈值 t,若数据集中特征点与 M 之间的投影误差小于t,就把该点加入内点集,重复以上步骤,迭代结束后对应内点数量最多的情况即为最优匹配。RANSAC 对误匹配点的剔除依赖单应性矩阵的计算,存在计算量大、效率低等问题。

文献[37] 通过引入针对内点和外点的混合概率模型实现了参数模型的最大似然估计。

文献[38] 使用支持向量回归学习的对应函数,该函数将一幅图像中的点映射到另一幅图像中的对应点,再通过检验它们是否与对应函数一致来剔除异常值。

将点对应关系通过图匹配进行描述[39-40]

为了在不依赖 RANSAC 情况下恢复大量内点,Lin 等人【41】提出 BF( bilateral functions) 方法,从含有噪声的匹配中计算全局匹配的一致函数,进而分离内点与外点。BF从一组初始匹配结果开始,利用每个匹配定义的局部仿射变换矩阵计算两幅图像之间的仿射运动场。在给定运动场的情况下,BF为每个特征在描述符空间寻找最近邻匹配以恢复更多对应关系。与RANSAC 相比,双边运动模型具备更高的查全率和查准率。

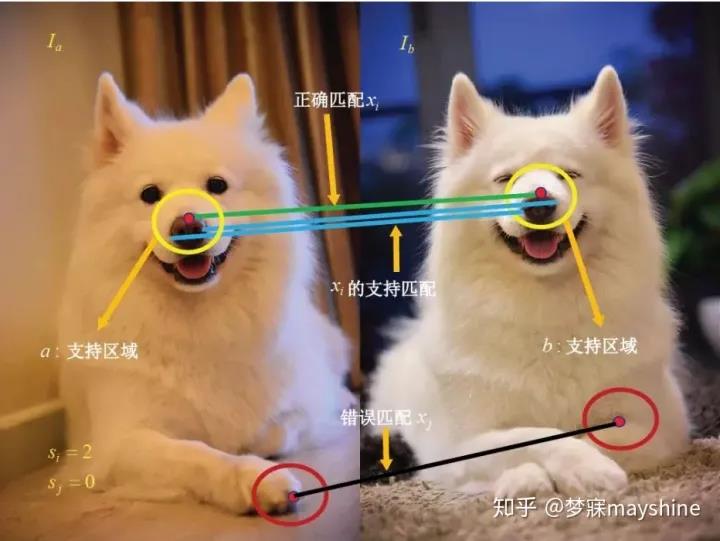

受BF启发,Bian 等人【42】将运动平滑度作为统计量,提出基于网格的运动统计( GMS) 方法,根据最近邻匹配数量区分正确匹配和错误匹配点对。GMS 算法的核心为运动统计模型,如图 4 所示。其中,si 和 sj 分别表示正确匹配 xi 和错误匹配 xj 的运动统计,为了加速这一过程,可将整幅图像划分成 G = 20 × 20 的网格,并在网格中进行操作。由于 GMS 算法在进行网格划分时,并未考虑图像大小,对于长宽比例不一致的图像,会生成矩形状的网格,导致网格中特征分布不均。基于此,文献[43]通过计算五宫格特征分数剔除外点,并将图像大小作为约束对图像进行方形网格划分,能够在提高运算速度的同时获得与 GMS 算法相同的匹配精度。

3.7.2 几何约束为非参数

Ma 等人[44]提出 VFC( vector field consensus) 方法,利用向量场的光滑先验,从带有外点的样本中寻找向量场的鲁棒估计。向量场的光滑性由再生核希尔伯特空间( RKHS) 【45】范数表征,VFC 算法基于这一先验理论,使用贝叶斯模型的最大后验( MAP) 计算匹配是否正确,最后使用 EM 算法将后验概率最大化。VFC 算法的适用范围: 1) 误匹配比例高的时候( 遥感图像、红外图像和异质图像) ; 2) 无法提供变换模型的时候(如非刚性变形、相机参数未知);3) 需要一个快速匹配算法且不需要求解变换参数的时候。

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。